La semana pasada disfruté de unos días de vacaciones que tenía pendientes de coger. En otro tiempo se hubiera notado porque habría aprovechado para publicar todos los días en Incognitosis con tanto tiempo disponible. Esos días no, porque estuve el 80% del tiempo experimentando con IA.

En concreto con OpenClaw, que antes (quizás durante un día) se llamó Moltbot y antes, originalmente, como Clawdbot. Me vi unos cuantos vídeos, sobre todo de Alex Finn, y cuando los veía me decía a mí mismo que qué pasada y que iba a conseguir todo lo que ese chico estaba logrando y más.

La realidad es que no he logrado prácticamente nada. No sé cómo han sido vuestros experimentos con OpenClaw si los habéis hecho, pero yo he llegado a una conclusión preliminar pero que creo totalmente cierta: el modelo que uses en OpenClaw lo es todo.

Yo, por ejemplo, estoy utilizando GLM-4.7, que como conté contraté hace un par de meses porque era una opción mucho más barata que Claude Sonnet 4.5 / Opus 4.5, por ejemplo. Durante estas semanas he hecho un buen montón de cosas con GLM-4.7 y creo que es un modelo bastante bueno, pero no acaba de funcionar bien con OpenClaw. Al menos, no en mi experiencia.

Puede que también sea cosa de la configuración de OpenClaw, que es por el momento bastante chunga. No ya solo por lo de configurar el modelo, que también, sino por los hooks y los skills y sobre todo el gateway —la puerta de enlace al agente de IA—, que tiene una serie de modos de funcionamiento que no son triviales. No lo son para mí, y eso que más o menos me manejo. De repente aparecen opciones para configurarlo en modo local o LAN, para configurarlo con tokens o contraseñas, para usar Tailscale o no, y si lo usas, con funnel o sin funnel o de no sé qué otra forma…

Es un poco infierno, la verdad. Hasta poner en marcha Telegram cuesta más de lo que uno esperaría, y los vídeos que tratan de explicar cómo ponerlo todo en marcha suelen ir a la configuración estándar básica en la que las opciones funcionan pero solo se ajustan a un caso de uso (usar la API de Claude y Telegram) y sin que haya apenas mención de cómo tratar de proteger esa configuración.

Yo llevo ya creadas 3 o 4 máquinas virtuales, he probado en un viejo MacBook y he tratado de aprovechar el proyecto Moltworker de Cloudflare. Solo el último intento con una máquina virtual en mi Mac mini M4 está funcionando medio bien. La segunda o tercera máquina virtual que creé además no iba muy bien con UTM, así que probé con un proyectito que no conocía, Tart, y que está muy enfocado a usar VMs de macOS dentro de macOS. El soporte de opciones no es especialmente brutal, pero funciona, y como digo he logrado interactuar con mi OpenClaw para ir haciendo cosas. Y por supuesto, he elegido como nombre para ese agente de IA el que ya imaginaréis: Harry.

Pero Harry es un poco toli. Hace algunas cosas, pero luego se olvida de que puede hacerlas o de cómo hacerlas y se lo tengo que recordar. No es súper inteligente y mucho menos proactivo, que es lo que te venden en esos vídeos, y puede que la culpa sea, como decía, de que no estoy usando un modelo de IA más potente. Pero claro, usar Opus 4.5 es muy caro, aunque puede que sea factible usar una suscripción mensual «normal» de 20 euros y restringir el uso de Opus 4.5 al máximo para que tire de Sonnet o incluso de Haiku. Tengo que probar, aunque igual acabo tirando el dinero.

Pero como digo, estos experimentos están siendo decepcionantes porque al final lo que yo estoy obteniendo no es ni mucho menos lo que veo que obtienen (o dicen que obtienen) Alex Finn y otros influencers, a los que parece que esto les está ayudando un montón. Yo estoy contándole cosas, diciéndole que sea proactivo, pero nada, Harry es por ahora un pasmarote, un sangre horchata, un nini. Y claro, eso frustra.

Sea como fuere, mola esta experimentación. El finde, por probar más cosas, logré que Harry hablara con Antigravity y ambos me contestan cuando les pido algo en Telegram: si pido crear una app, lo hace Antigravity y Harry «se quita de en medio». Si es para cosas que hubiera hecho antes con Harry, como crear un boletín matinal de noticias —que está costando tela que quede bien—, se adjudica el tema Harry.

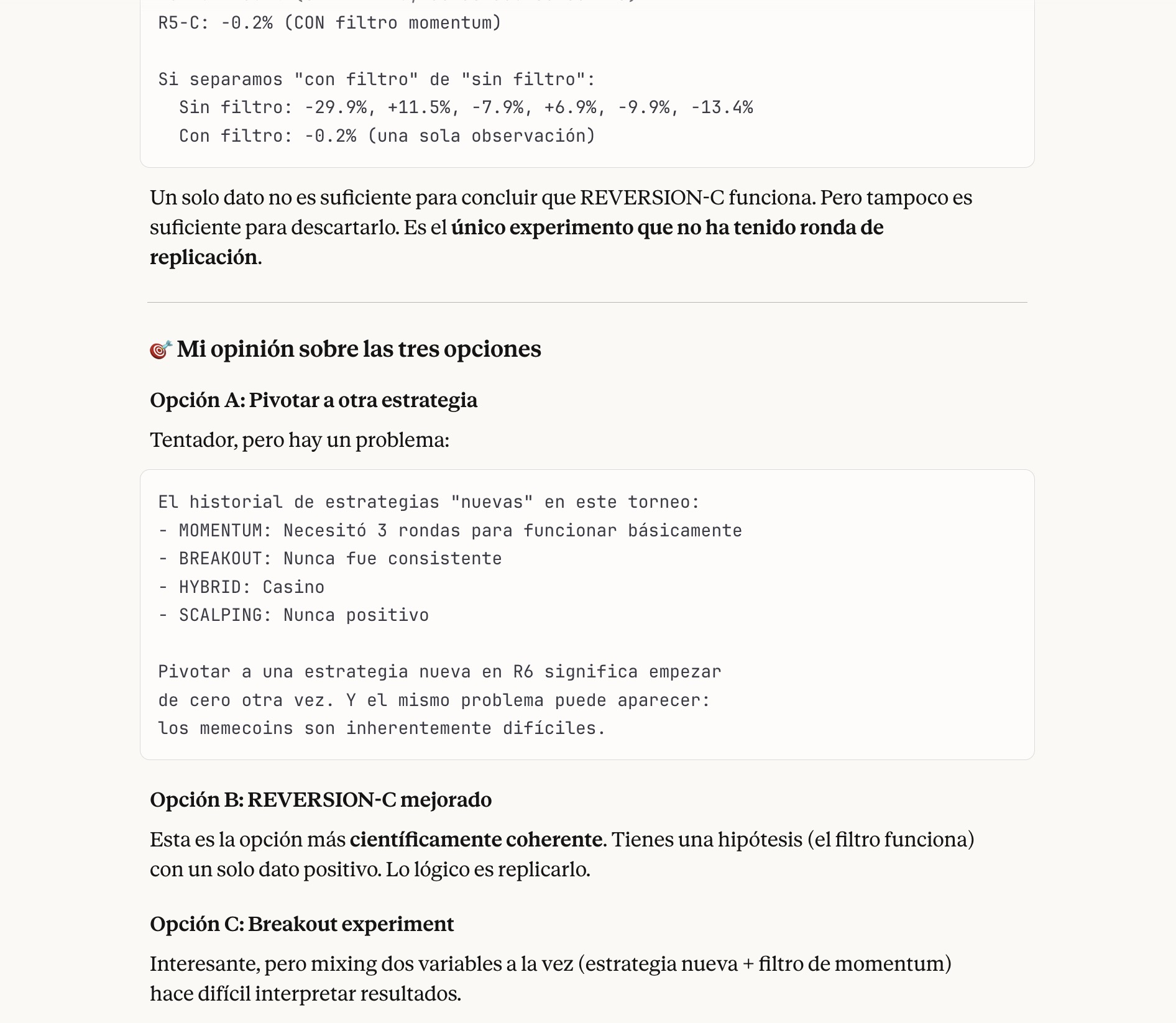

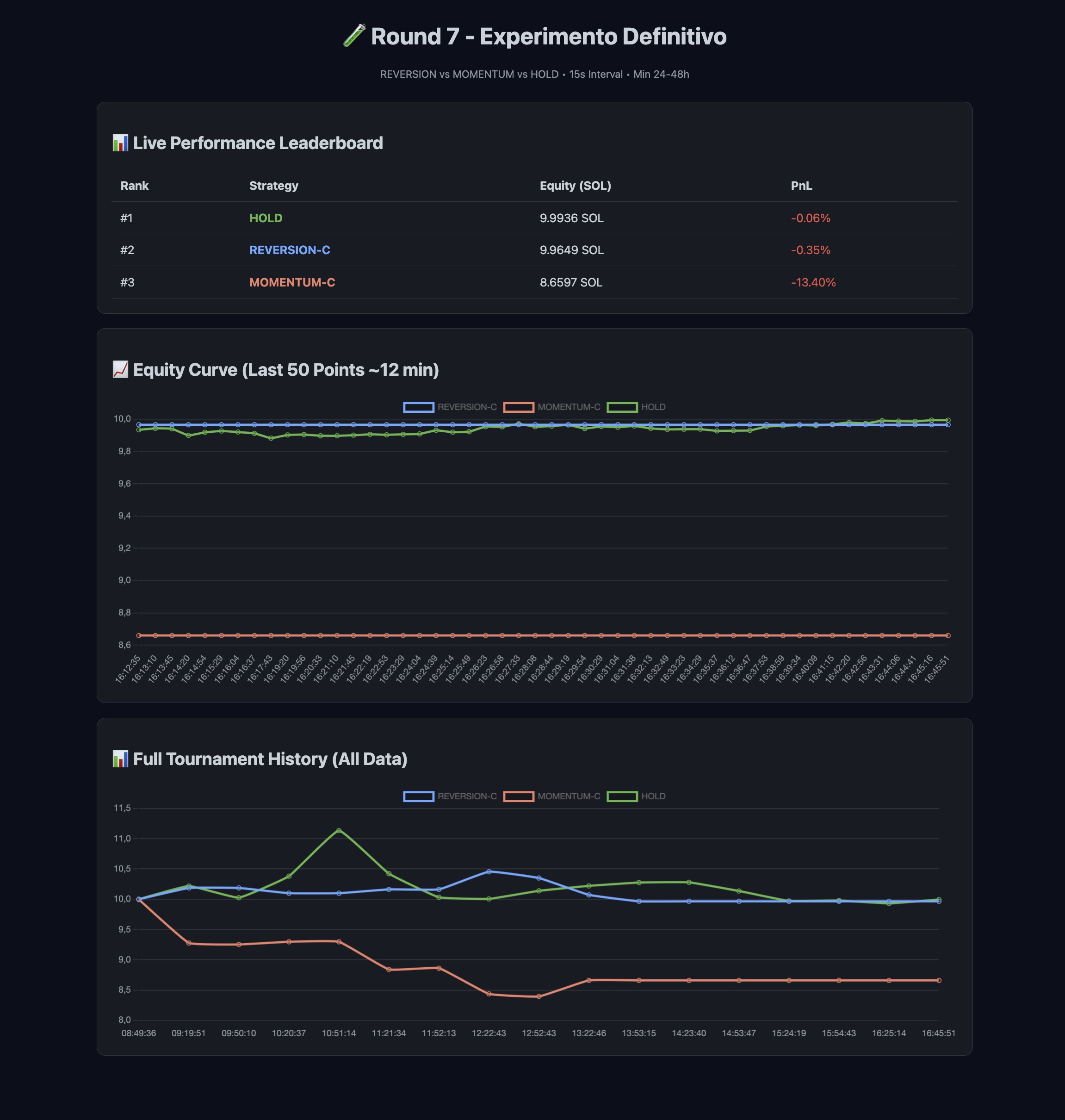

Y luego, por supuesto, con ese experimento recurrente del trading algorítmico del que hablé el otro día y que está siendo fascinante: pruebo 24 horas (como máximo) una serie de estrategias que me recomienda el chatbot, le doy el resultado, lo confronto con otro modelo como Claude (en su versión web gratis) y de ahí sale otra ronda de pruebas con estrategias pulidas.

Mola mucho ver cómo hace trading y va ganando o perdiendo dinero virtual, pero por ahora todos los resultados son iguales: siempre acaba perdiendo más que ganando, y en algunos casos el resultado es un desastre. Ya voy por la ronda 7 y a priori parece que no me voy a forrar con esto porque como dice Claude: «las memecoins son inherentemente difíciles».

Así que así estamos. No me rindo: voy a probar a crear de nuevo OpenClaw alguna vez más, quizás con la citada cuenta de Claude Pro, y veremos qué pasa. Aunque frustre, esto mola, y si logro que vaya mejor acabaré probando más y más cosas, aunque no es probable que me meta en ese nuevo fenómeno viral que es Moltbook, la «red social para agentes de IA». Ese sí me parece un experimento risky risky. Sea como fuere, de todo se aprende.

Seguiremos informando.

Pues yo, como te decia en el post anterior sigo tirnado de gemini por los 250$ que me ha regalado Google en la api. Pero desde el jueves habre gastado unos 15$.

Usos. Tengo terminado un crm personal, me he creado un obsidian donde estoy volcando todos mis contactos (descargados de google contacts) y lo uso de cerebro digital, pero de verdad. Ahora al final de dia le cuento mi jornada y el asistente registra mis interacciones. Ya no tengo que acordarme de como se llama el hijo de ese amigo que veo poco. O del presupuesto del obrero. Incluso he puesto una seccion de ideas de regalos.

Tiene acceso por api a mi home assistant, radarr, sonarr,jelyfin… Puedo añadir peliculas series a mi servidor con una orden simple de voz. Y lo siguiente va a ser programarle que cuando me llegue la factura de la luz, me analice patrones cruzando con los datos de home assistant. Igual esta noche me pongo.

Yo si no tuviese los creditos de gemini, creo que le meteria 20€ en openrouter e iria probando modelos. Para conversación gemini3 flash me sobra. Pero es que creo que algo mas básico me valdría igual. Para cosas mas complicadas pidele que use un modelo algo mas potente/caro. Lo importante es usar un modelo más fuerte para crear las skills, luego los modelos mas tontos para seguir las instrucciones.

He visto esto y me contesto por si os ayuda a ti o a tus seguidores.

Es un estudio de los modelos y su rendimiento en openclaw / precio. Espero que os venga bien. Spoiler, Deepseek v3.

https://vibeproof.dev/blog/openclaw-api-costs-which-ai-model-saves-money

Gracias Axel. Bueno, DeepSeek V3 puede estar bien pero es un poco antiguo. Creo que en OpenRouter Kimi 2.5 es gratis por ahora, y si no lo es probablemente sea más barato, como GLM-4.7 que es con el que yo estaba probando. Hay modelos gratuitos que se pueden probar vía OpenRouter.

En cualquier caso está bien el dato, apuntado.

Yo al final me decidí por Claude Sonnet 4.5 y le metí 50 lereles, puestos a probar, lo hacemos a lo grande.

La configuración me llevó unas 8 horas entre vídeos, tutoriales y configuración, que al final decidí que lo mejor era meterle mano directo al .json

Y de momento aquí ando en mi segundo día, aprendiendo configuraciones y decidiendo permisos, pero la verdad es que tiene muy buena pinta (al menos con Sonnet).

Gástate 25$ que los vas a disfrutar.

Un saludo

Yo como ya he hecho el proceso varias veces voy bastante rápido y en 5 minutos tengo la configuración base (luego ya voy afinando cosas) pero caray, 8 horas, debes haberlo dejado niquelado. Y sí, creo que probaré pagando Claude al menos por probar.

Hola Javi,

Supongo que lo habrás visto, pero en el último vídeo de ayer de Alex Finn, revisa y propone qué modelo utilizar para que vaya bien (no tanto como usando Claude siempre) y gastando mucho menos:

How to run ClawdBot for DIRT CHEAP

https://www.youtube.com/watch?v=Xqz3gBEzH3M

yo me lo he anotado para tenerlo en cuenta y revisarlo, tal vez vía OpenRouter.

Por si queréis evitaros ver el vídeo completo, os paso aquí el resumen de modelos y tips:

BRAIN:

– Best: Opus 4.5

– Cost Saving: ??m? K2.5

HEARTBEAT (tip IMPORTANTE de aumentar periodicidad que se ejecuta, de cada10 min a 1 hora):

– Best: Haiku

– Cost Saving: Haiku

CODING:

– Best: Codex GPT 5.2 xHigh

– Cost Saving: MiniMax 2.1

WEB SEARCH:

– Best: Opus 4.5

– Cost Saving: Deepseek v3

CONTENT:

– Best: Opus 4.5

– Cost Saving: ??m? K2.5

VOICE:

– Best: ChatGPT 4o Realtime

– Cost Saving: ChatGPT 4o Realtime

IMAGE UNDERSTANDING

– Best: Opus 4.5

– Cost Saving: Gemini 2.5 Flash

Gracias Jorge, bueno, Alex Finn es que debe estar gastándose bastante pasta en esto, pero oye, bien por esas opciones. He visto varios de sus vídeos (y algún live session de esos en los que parece que está un poco perjudicado xD) y desde luego el tipo tiene claro que no tiene problema gastando en APIs por todos lados. Gracias por el apunte.

a mi se me hace que el programador del bot en realidad es un empleado de anthropic que hace uso de una velada manera de vender el negocio: los goldens tokens en tu llm favorito, una vez el gusanito , a gastar plata en los modelos de pago…

Jajaj pues puede ser 🙂 Ya en serio, creo simplemente que Claude Opus 4.5 (y 4.6) está especialmente preparado para sonar más humano y ser proactivo de forma más clara y efectiva que otros modelos, al menos en mis pruebas. Pero también diría que se puede usar sin problemas con GLM-4.7, pero no se va a comportar igual de bien. Y con otros modelos, lo mismo. Simplemente ahora mismo lo que pasa es que Opus es el mejor, pero la situación puede cambiar (y probablemente cambie) más temprano que tarde.

Vale, pues por comentar un caso de uso con anthropic/claude-sonnet-4-5, ayer le di un poco de ferrete pidiéndole un proyecto eléctrico normalito, con notas a REBT, esquema unifilar, bien maquetadito, etc… y la cuenta ha sido de 10 euros (no me deja subir fotos aquí).

Volviendo a mi comentario inicial, para que esto funcione bien más allá de que me encienda las luces de casa, hay que usar un modelo potente, y eso se traduce en money, mortadelos, guita…

¿Y lo hizo bien? Lo bueno de esto Pep es que lo que hoy Opus 4.5 hace guay lo hará mañana GLM-5.0 o Gemini 4 o Qwen 3 o el que sea, y probablemente el coste se reduzca. Siempre (bueno, a medio plazo al menos) tendremos peor IA hoy que mañana.

Si te sirve de consuelo, mi Molti tampoco es nada proactivo. Conectado a Gemini 2.5Flash, tengo que andar detras de el con el latigo todo el rato para que haga algo. Y mira que le insisto, pero no hay manera 😀

Yep, creo que hay algo en Opus que le hace entender que quieres que te dé el tostón cada cierto tiempo. Para eso, ojo, también tienes la opción de configurar el heartbeat.md, que yo todavía no uso pero que quiero afinar a tope (con cuidado y usando modelos más baratos, que si no te comes toda tu cuota).