Como buen rebeldillo friqui sin causa, tardé en ceder a la poderosa Intel. No lo hice los 80 —C64 al poder— ni en los 90, porque aguanté mucho y bien con mi Amiga 1200 que primero usé con su Motorola 68020 nativo y que luego mejoré con una aceleradora con el 68060.

Acabé comprando mi primer PC en 1999, justo antes de comenzar a trabajar en PC Actual, y claro está, el mundo era de Intel. O de Wintel, como solíamos decir. AMD hacía unos procesadores que parecían estar bien pero de los que nadie se fiaba del todo aún, así que duré con aquellos micros una época.

Luego experimentaría con un invento singular: tuve un ordenador con dos procesadores —dos dies— gracias a un contacto que me consiguió una placa de Supermicro con dos zócalos para dos AMD Athlon MP (Multiprocessing). Que era básicamente lo que hoy tenemos con los procesadores normales, que son multicore, pero que entonces sólo se podía conseguir así, porque cada procesador tenía un único núcleo. Me sentía un pionero, un visionario, un rebelde friqui sin causa. Era maravilloso, aunque luego no sirviera de mucho, al menos por lo que recuerdo.

Pero aquello daba igual. Quien marcaba los tiempos era Intel, que entre otras cosas parecía absolutamente imparable con el modelo Tick-tock que siguió durante años: si un año mejoraba el proceso fotolitográfico (tick), al siguiente mejoraba la microarquitectura (tock), y así durante años. La evolución de sus micros, tanto en uno como en otro sentido, era envidiable, y aunque AMD hacía cosas chulas, siempre estaba en segundo plano. Hasta Apple decidió dar el salto a sus chips, algo que desde luego demostraba quién mandaba en ese terreno entonces.

Intel parecía inmortal.

Pero llegaron los smartphones e Intel no supo (o no quiso) tratar de competir en ese terreno. Supongo que creyeron que el PC reinaría para siempre. Y no. El PC sigue siendo importante, pero lo es mucho más el móvil, y ahí Intel es un absoluto donnadie —se puede escribir así, lo he buscado, listillos—.

Fue el primer error.

Luego vinieron otros, que han sido probablemente más pequeños pero han ido acumulándose para provocar la situación actual. El retraso en la mejora del proceso de fabricación y fotolitografía fue escandaloso —¿os acordáis de que nunca acababan de llegar sus CPUs de 10 nm?— demostró que algo no funcionaba en Intel, y mientras ellos no paraban de meter la pata, TSMC les adelantaba por la derecha. Ellos y otros como Samsung, MediaTek y por supuesto Apple —aunque sus chips los fabrica la mencionada TSMC— han logrado hacer algo que parecía imposible: comerle la tostada a Intel y hacer todo lo que ellos hacían, pero mejor.

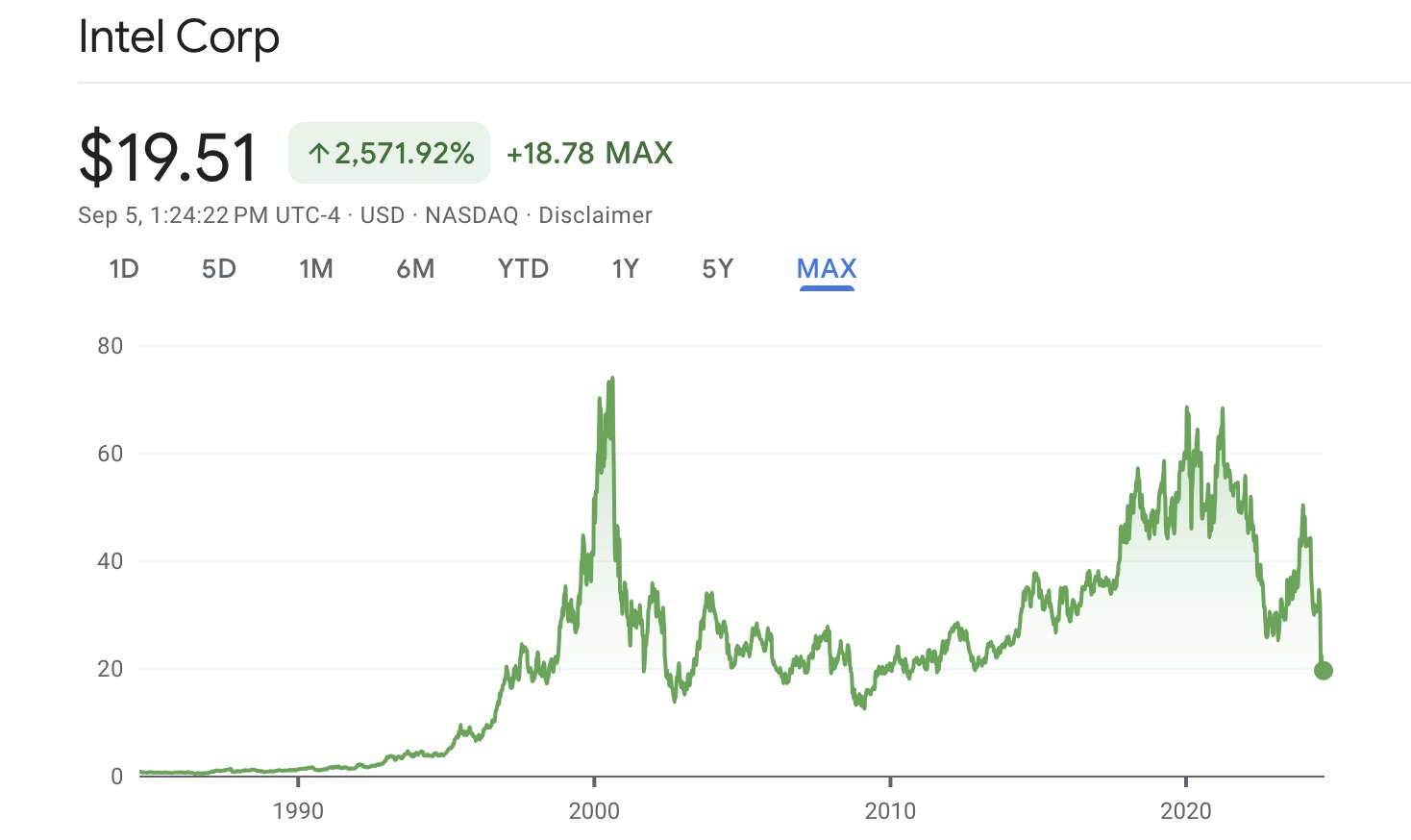

Y así llegamos hasta nuestros días, con una Intel que también se está perdiendo la era de la IA —AMD, en cambio, ha reaccionado—, y que no para de tener más y más problemas. Para una empresa con una historia tan singular —hace hablé de los ocho traidores—, la situación actual es terrible.

Lo curioso es que esa situación no es nueva. Hablé de ella hace cuatro años, cuando comparé a Intel con Nokia, que pasó del todo a la nada (o casi) en un periodo de tiempo realmente corto. Ese peligro sigue ahí, y un nuevo y detallado artículo de Ben Thompson en Stratechery —donde hace años también habló del problema de Intel— volvía a incidir sobre el tema. No parece que Thompson sea especialmente optimista con las decisiones que está tomando la compañía, y la verdad, yo tampoco. Y me da rabia, porque parecía que Pat Gelsinger parecía estar logrando cosas importantes. Parecía renacer.

Pero no acaba de hacerlo. Familias como los chips Meteor Lake prometían y luego se quedaron en un meh. Ahora los nuevos Lunar Lake son aún más prometedores, pero queda por ver dónde llegan. Y mientras, la competencia está imparable, rompiendo barreras en fotolitografía y chips cada vez más eficientes, y con empresas como NVIDIA o MediaTek amenazando con hacer como Qualcomm y meterse a diseñar y producir chips ARM para los PCs. De momento a Qualcomm no parece que le vayan a ir muy bien sus Snapdragon X Elite —precisamente por lo nuevo de AMD e Intel—, pero ese es solo un primer paso, y puede que la cosa vaya efectivamente a más.

Y como comenta Land, se me había pasado otro tema: en centros de datos Intel también está perdiendo también protagonismo poco a poco (aunque sigue siendo el más relevante). Los Threadripper y los EPYC aquí son competidores formidables, aunque con la fiebre de la IA quien está amasando de verdad es NVIDIA con sus GPUs.

En fin. Intel debe intentar recuperarse de verdad. O eso, o acabar reestructurándose de forma radical para volver a ser lo que era, o al menos, intentarlo. Hoy por hoy eso parece imposible, pero claro, hace unos años lo impensable es que Intel estuviera donde está.

Reacciona, Intel. Reacciona.

Ni una mención a los Ryzen, Threadripper y Epic. Se ve que la competencia que se ha comido parte del pastel de Intel en lo que llegó a ser su «jardín privado» tiene poca relevancia (en servidores Intel lleva sin competir 5-6 años y parece que ahora empieza a tener algo para estar a la altura). Todo ha sido por los móviles, Apple y la IA…

Es cierto, la parte de centros de datos -donde AMD compite de tú a tú, ya ronda el 50% de cuota— es relevante. Edito para mencionarlo, pero la conclusión sigue siendo la misma: los problemas que están teniendo con la fotolitografía afectan a todos sus productos, sean de consumo o sean dirigidos a centros de datos.

Es curioso como lo que se suponía que era una medida desesperada para AMD en su momento, como lo fue desprenderse de su estructura de fabricación y litografía y crear una empresa a parte, Global Foundries, para así poder aprovechar las mejoras en procesos litográficos de otras empresas, pueda ser la salvación de Intel: dedicarse al diseño y dejar la litografía para otros.

Saludos que buen block, yo no soy amigo de Intelas de amd por las gráficas ojalá para la empresa, para los que les gusta Intel etc ellos (Intel ) hagan lo suyo y vuelvan a la batalla

Yo resistía hasta mil novecientos noventa y siete y entonces cedí pero con un AMD K5

Nunca nunca he tenido un equipo Intel en casa… De sobremesa